Robot sát thủ là tương lai – ít nhất là theo ý tưởng của Nga và Mỹ. Cuộc chiến ở Ukraine đang thúc đẩy sự phát triển của các hệ thống vũ khí tự động. Nhưng những nguy hiểm của máy bay không người lái có thể xác định, lựa chọn và tiêu diệt mục tiêu một cách độc lập là gì?

Nó sẽ là sự khởi đầu của một kỷ nguyên chiến tranh mới. Các chuyên gia quân sự, chính trị gia và nhà khoa học đã thảo luận về tiềm năng của máy bay không người lái chiến đấu tự động trong nhiều năm. Cuộc xâm lược Ukraine của Nga đã tạo động lực mới cho cuộc tranh luận. Và: Chiến tranh càng kéo dài thì càng có nhiều khả năng sử dụng các máy móc xác định, lựa chọn và tiêu diệt mục tiêu một cách độc lập trên chiến trường.

Điều này cũng được chỉ ra bởi một tuyên bố gần đây của Bộ Quốc phòng Hoa Kỳ. Trong đó, quân đội Mỹ khẳng định ý định đẩy mạnh phát triển và sử dụng vũ khí tự hành. Đây là lần đầu tiên sau gần một thập kỷ, Bộ này tập trung vào các hệ thống vũ khí sử dụng trí tuệ nhân tạo (AI). Thông báo này tuân theo kế hoạch thực hiện của NATO đã được thống nhất vào năm 2022 nhằm duy trì „sự dẫn đầu về công nghệ“ của liên minh trong cái gọi là robot sát thủ.

Cả Ukraine và Nga đều chưa sử dụng vũ khí AI ở tiền tuyến. Tuy nhiên, điều đó có thể thay đổi sớm. Ukraine đã có máy bay không người lái bán tự động sử dụng AI để chống lại máy bay không người lái của kẻ thù. Bộ trưởng chuyển đổi kỹ thuật số của Ukraine, Mykhailo Fedorov, chắc chắn rằng robot sát thủ là „bước tiếp theo hợp lý và không thể tránh khỏi„. Ông nói với hãng tin AP rằng đất nước của ông đã thực hiện „rất nhiều nghiên cứu và phát triển theo hướng này„. „Tôi nghĩ rằng có rất nhiều tiềm năng cho điều đó trong sáu tháng tới.“

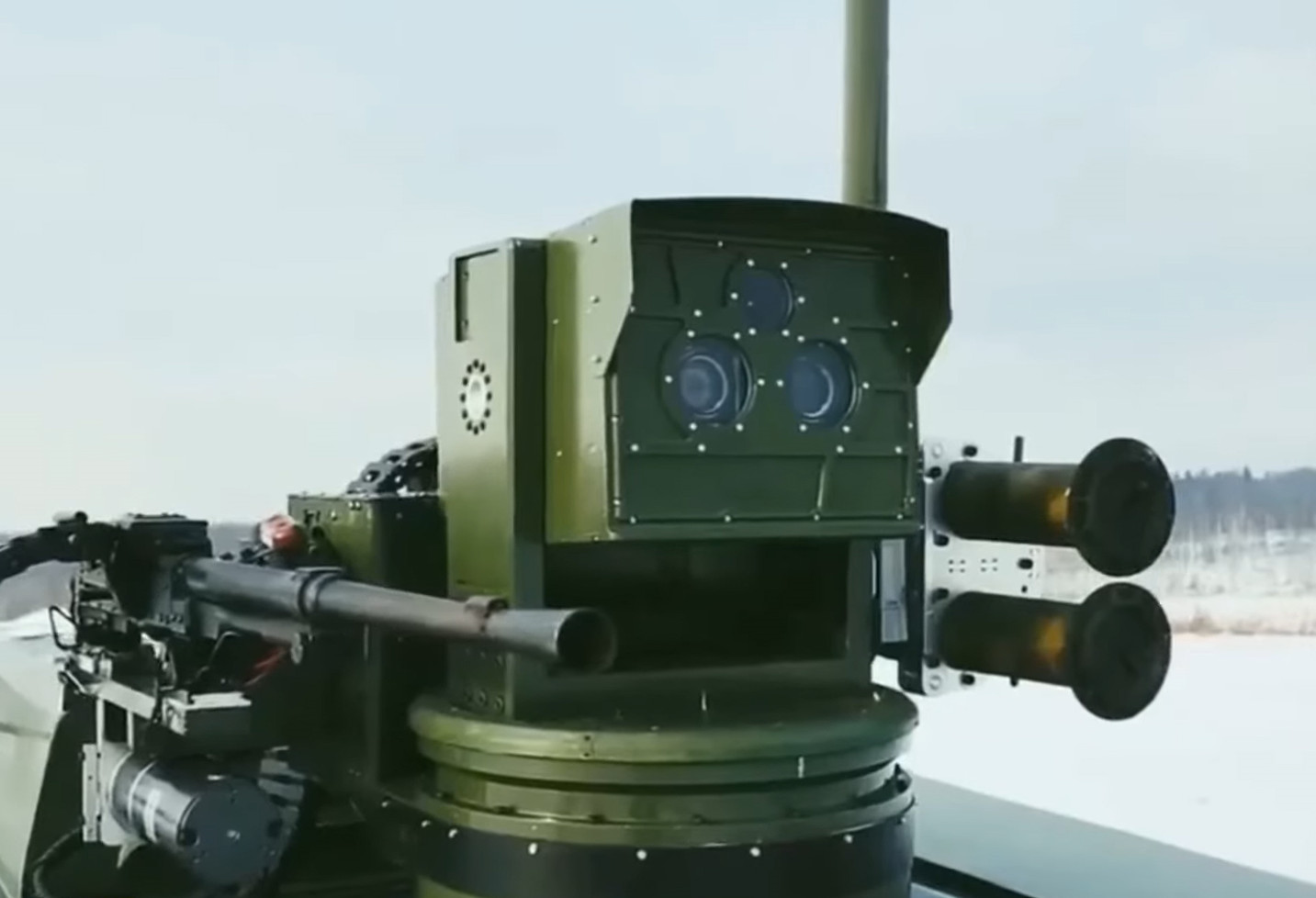

Cho đến nay, máy bay không người lái của Nga không đặc biệt thông minh

Theo tuyên bố của chính mình, Nga cũng đang phát triển vũ khí tự trị. Các phương tiện mặt đất „đánh dấu“ không người lái phải được trang bị thêm các mô-đun vũ khí thích hợp để chúng có thể được sử dụng chống lại xe tăng như Leopard 2 hoặc M1 Abrams. AI sẽ có thể phân biệt giữa các loại xe tăng và cũng có thể tự đánh giá xem mục tiêu là dân sự hay phương tiện chiến đấu. Tuy nhiên, cho đến nay, không có bằng chứng về khả năng như vậy.

Nhưng Nga chắc chắn có thể lấy vũ khí AI từ Iran chẳng hạn. Máy bay không người lái Shahed do Iran sản xuất đã được Moscow sử dụng với số lượng lớn đã phá hủy các nhà máy điện và khủng bố người dân Ukraine – nhưng chúng không được coi là đặc biệt thông minh. Nhưng Tehran cho biết họ có các loại máy bay không người lái khác trong kho vũ khí của mình, một số trong số đó hoạt động rất tốt với AI.

Mặt khác, theo các nhà sản xuất phương Tây, Ukraine có thể dễ dàng chuyển đổi máy bay không người lái chiến đấu bán tự động của mình thành vũ khí hoạt động hoàn toàn độc lập. Với những máy bay không người lái này – trong đó có Switchblade 600 của Mỹ và Warmate của Ba Lan – một người luôn chọn mục tiêu với sự trợ giúp của việc truyền hình ảnh trực tiếp. Sau đó, một hệ thống AI sẽ thực hiện phần còn lại.

Wahid Nawabi, người đứng đầu nhà sản xuất AeroVironment nói với mạng biên tập của Đức: “Công nghệ để thực hiện một nhiệm vụ hoàn toàn tự động với Switchblade về cơ bản đã có sẵn“. Các hệ thống hiện tại đã có thể xác định các mục tiêu như xe bọc thép bằng cách so sánh chúng với hình ảnh được lưu trữ. Tuy nhiên, vẫn còn tranh cãi liệu công nghệ này có đủ tin cậy để loại trừ hoàn toàn khả năng máy móc mắc lỗi và sau đó giết chết những người có thể không liên quan gì đến các hoạt động chiến đấu hiện tại hay không.

AI tốt hơn con người?

Theo Nawabi, việc sử dụng vũ khí AI đòi hỏi một sự thay đổi chính trị tất nhiên cho phép mọi người được đưa ra khỏi „vòng quyết định“ tương ứng. Rốt cuộc, máy tính có thể phản ứng nhanh hơn nhiều so với con người. Những người ủng hộ các hệ thống vũ khí tự động hoàn toàn cũng lập luận rằng công nghệ này có thể ngăn chặn nhiều cái chết bằng cách giữ cho binh lính của chính họ không tham chiến. Ngoài ra, các quyết định quân sự có thể được đưa ra với tốc độ siêu phàm, giúp tăng đáng kể khả năng phòng thủ.

Tổng thống Nga Vladimir Putin cũng nằm trong số những người ủng hộ. Ngay từ năm 2017, ông đã nhấn mạnh tầm quan trọng của các hệ thống AI đối với chiến tranh trong tương lai. Ông đã nói vào thời điểm đó: Bất cứ ai thống trị công nghệ này sẽ thống trị thế giới. Và xét theo tuyên bố mới nhất của Bộ Quốc phòng Mỹ, Nhà Trắng cũng có quan điểm tương tự.

Mặt khác, các tổ chức như Chiến dịch ngăn chặn rô bốt sát thủ lại chỉ trích việc loại bỏ những điều cấm kỵ đối với rô bốt sát thủ. Họ lo sợ một tương lai trong đó các hệ thống vũ khí tự động được thiết kế đặc biệt để chống lại con người, không chỉ phương tiện, cơ sở hạ tầng và các loại vũ khí khác. Trên trang web của họ, các nhà hoạt động lập luận rằng quyết định sinh tử phải nằm trong tay con người trong thời chiến. Để chúng vào tay một thuật toán sẽ là hình thức phi nhân hóa kỹ thuật số cuối cùng.

Tổ chức nhân quyền Human Rights Watch nhận thấy một mối nguy hiểm khác: Những công nghệ tự trị như vậy hạ thấp ngưỡng ức chế đối với các cuộc xung đột vũ trang bằng cách giảm các rủi ro có thể nhận thấy. Bà cũng cáo buộc Mỹ, Nga, Trung Quốc, Hàn Quốc và Liên minh châu Âu, trong số những nước khác, đẩy thế giới vào một cuộc chạy đua vũ trang mới tốn kém và gây bất ổn bằng cách đầu tư nhiều hơn vào các hệ thống vũ khí tự trị. Ví dụ, kết quả có thể là công nghệ mạnh mẽ đó rơi vào tay bọn khủng bố.

Không có quy tắc quốc tế

Bộ Quốc phòng Hoa Kỳ cố gắng giải quyết một số lo ngại này trong thông báo của mình. Họ tuyên bố rằng Hoa Kỳ sẽ triển khai các hệ thống vũ khí tự trị với „mức độ phán đoán hợp lý của con người trong việc sử dụng vũ lực.“ Tuy nhiên, Tổ chức Theo dõi Nhân quyền phàn nàn rằng họ không làm rõ thuật ngữ „mức hợp lý“ nghĩa là gì. Ngoài ra, người ta không nói ai nên xác định biện pháp này.

Và ngay cả khi Mỹ đặt ra các hướng dẫn nghiêm ngặt về việc sử dụng robot sát thủ, không có gì đảm bảo rằng các quốc gia như Nga hay Trung Quốc sẽ tuân thủ. Những nỗ lực thiết lập các quy tắc quốc tế luôn không thành công trong quá khứ. Trong khi đó, không chỉ Nga bác bỏ lệnh cấm mà Mỹ cũng quyết liệt phản đối.

Nhà hoạt động và nhà khoa học người Úc Toby Walsh hy vọng sẽ có thỏa thuận về ít nhất một số lĩnh vực quy tắc đối với vũ khí AI – chẳng hạn như lệnh cấm các hệ thống sử dụng nhận dạng khuôn mặt và dữ liệu khác để xác định và giết những người hoặc nhóm người cụ thể . „Nếu chúng ta không cẩn thận, chúng sẽ còn lan truyền dễ dàng hơn cả vũ khí hạt nhân„, tác giả cuốn Machines Behaving Badly nói với AP. „Nếu một robot có thể được tạo ra để giết một người, thì nó có thể được tạo ra để giết một nghìn người.“

Trung Khoa – (Tổng hợp)